近日,计算机学院刘威威教授团队论文“Generalization Bounds for Adversarial Contrastive Learning”(《对抗对比学习泛化误差界》)被机器学习顶级期刊Journal of Machine Learning Research(JMLR)录用,武汉大学计算机学院为该论文唯一署名单位,刘威威教授为唯一通讯作者,2021级博士研究生邹鑫为第一作者。这是计算机学院首次以第一作者单位在JMLR上发表论文。

Journal of Machine Learning Research(JMLR)是机器学习顶级期刊,是中国计算机学会认定的A类期刊(CCF-A),接受率约为18%。

深度神经网络(DNN)容易被攻击的性质阻碍了其在安全关键领域的应用,这引发了一系列关于如何提升对抗鲁棒性的研究。目前最好的方法之一就是对抗训练,但是有研究表明,对抗训练需要大量的数据,且很容易过拟合。为了增加训练的数据量,一些工作尝试将对比学习与对抗训练结合(对抗对比学习),从而可以利用大量的无标签数据,实验现象表明这样做能有效地提高对抗鲁棒性,但是相关的理论还未被探究。为了填补理论空缺,本文从理论上解释了为什么对抗对比学习可以有效地提升下游任务的对抗鲁棒性。

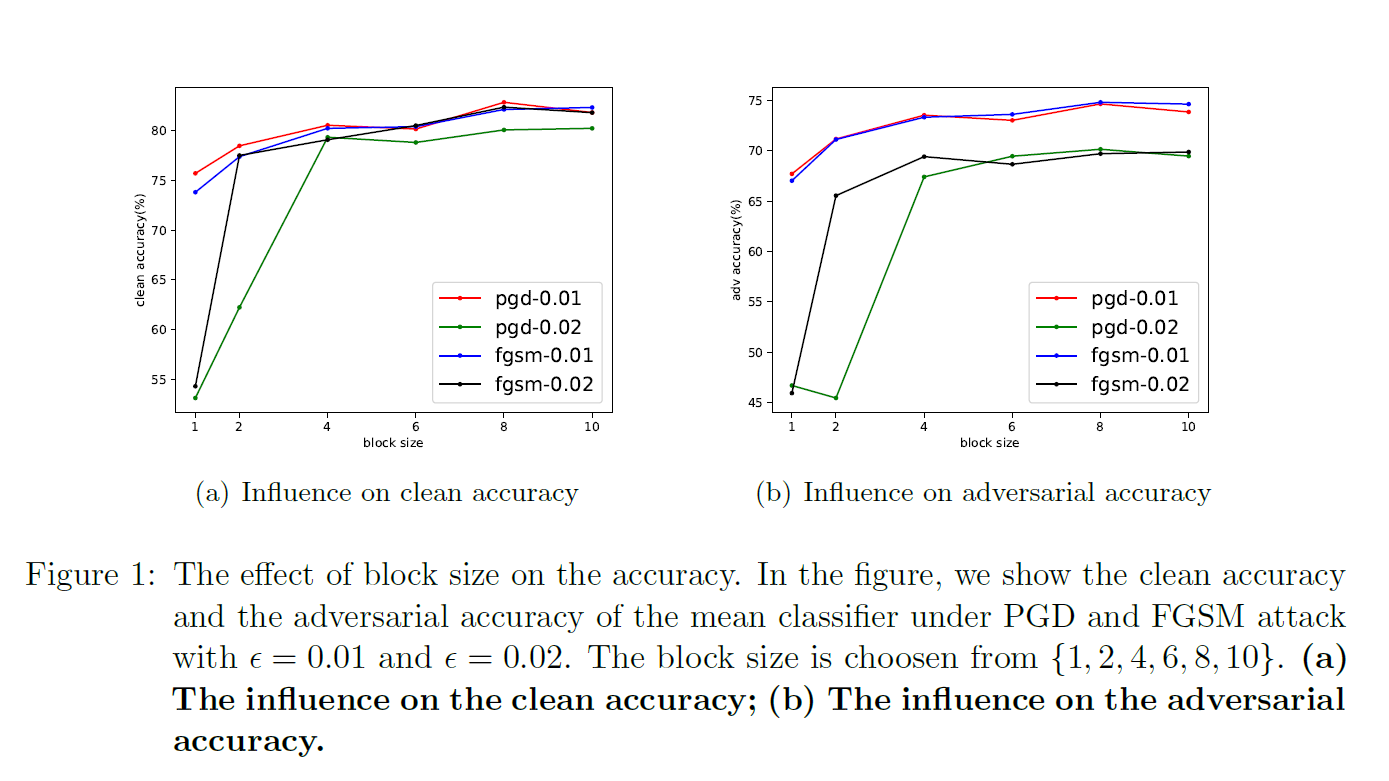

本文首先将传统的对比学习理论框架扩展到对抗的情形,然后证明了上游任务的对抗风险与对抗 Rademacher 复杂度的和是下游任务的平均对抗风险的上界,并且在线性模型和多层神经网络两种情况下给出了对抗 Rademacher 复杂度的上界,得到关于对抗对比学习的泛化误差界。本文的泛化误差界解释了有效地最小化上游任务的对抗风险可以帮助提升模型在下游任务上的对抗鲁棒性。此外,本文还做了一些实验来验证理论的正确性。

文章链接:https://arxiv.org/abs/2302.10633